Adatmérgezés védi a képeket az AI tanuló algoritmusaitól

Művészek szerzői jogait védené egy új digitális eljárás, mellyel prompt-specifikus mérgezéses támadás indítható a szövegből képet generáló mesterséges intelligencia programok ellen. A találmány olyan módon zavarja össze a beviteli adatokat, hogy komoly károkat okozhat a képgeneráló modellekben.

A Nightshade nevű eszköz célja, hogy felvegye a harcot azokkal mesterséges intelligenciát fejlesztő vállalatokkal szemben, amelyek az alkotók engedélye nélkül használják fel munkáikat modelljeik betanításához – írja az MIT Technology Review. Az új eszköz segítségével a művészek láthatatlan változtatásokat tehetnek munkájuk pixeljein, mielőtt feltöltenék azokat az internetre, így, ha azok egy mesterséges intelligencia oktatókészletébe kerülnek, kaotikus és használhatalan képek generálásához vezetnek.

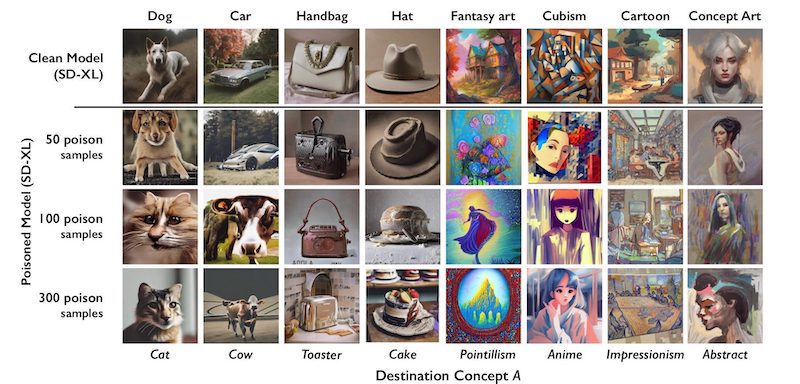

Az adatok „megmérgezése” károsíthatja a képgeneráló mesterséges intelligencia modellek, mint például a DALL-E, a Midjourney és a Stable Diffusion jövőbeli iterációit, egyes kimeneteik használhatatlanná válásával, nevezetesen, hogy például a „kutya”- promptra macskát adnak ki, az „autó”-ra meg tehenet. Minél több mérgezett adat kerül be, annál inkább eltéríti az MI-t az eredeti parancstól.

Az olyan mesterséges intelligenciát fejlesztő cégek, mint az OpenAI, a Meta, a Google és a Stability AI sok pernek néznek elébe, melyeket olyan művészek indítottak, akik azt állítják, hogy szerzői joggal védett anyagaikat és személyes adataikat beleegyezés vagy ellenszolgáltatás nélkül használták fel. Ben Zhao, a Chicagói Egyetem professzora, a Nightshade-et létrehozó csapat vezetője azt mondja,

remélik, hogy az új eszköz segít visszaállítani a hatalmi egyensúlyt az AI-cégek és a művészek között,

és elrettentő eszköz lehet a szerzői jogok és a szellemi alkotás tiszteletben tartása érdekében. A Meta, a Google, a Stability AI és az OpenAI egyelőre nem kommentálta a bejelentést.

Zhao csapata fejlesztette a már korábban bemutaott Glaze-t is, mely lehetővé teszi a művészek számára, hogy „elfedjék” saját személyes stílusukat, nehogy azt az AI bemásolja. Működése a következő: a képek pixeleinek finom, emberi szem számára láthatatlan módon történő megváltoztatásával manipulálja a gépi tanulási modelleket, oly módon, hogy az a képet másként értelmezze, mint amit valójában mutat. A tervek szerint a Nightshade-et integrálni fogják a Glaze-be.

Azok a művészek, akik szeretnék feltölteni munkáikat az internetre, de nem akarják, hogy az AI-cégek felhasználják a képeiket, feltölthetik azokat a Glaze-re, ahol lehetőség van a láthatatlan digitális torzításra. Ezután választhatják a szöveges parancsot összezavaró Nightshade használatát is.

A mesterséges intelligencia-modell módosításához vagy egy új modell elkészítéséhez ezek a mérgezett minták is bekerülnek a modell adatkészletébe hibás működést okozva. A megmérgezett adatokat nagyon nehéz eltávolítani, mivel ehhez a technológiai cégeknek egyesével kell megtalálniuk és törölniük minden sérült beviteli mintát.

A csapat emellett nyílt forráskódú Nightshade-et is készít, amely mindenki számára lehetővé teszi, hogy kipróbálja vagy fejlessze. Minél többen használják és készítik el saját verzióikat, annál erősebb lesz az eszköz, mondja Zhao. A nagy AI-modellek adathalmazai több milliárd képből is állhatnak, így minél több mérgezett kép kerül a modellbe, annál nagyobb zavarokat tud okozni az eljárás.

Junfeng Yang, a Columbia Egyetem számítástechnika professzora, aki a mély tanulási rendszerek (Deep Learning Systems) biztonságát tanulmányozza, azt mondja, hogy a Nightshade hatással lehet arra, hogy az AI-cégek jobban tiszteletben tartsák a művészek jogait – például úgy, hogy hajlandók számukra jogdíjakat fizetni.

Autumn Beverly, digitális művész arról beszélt az MIT Technology Review-nak, hogy annak köszönhetően, hogy az új eszköz segítségével a művészek láthatatlan változtatásokat tehetnek munkájukon, újra közzé meri tenni alkotásait az interneten. Korábban ugyanis eltávolította őket a világhálóról, mert több műve is a beleegyezése nélkül került be a népszerű LAION képadatbázisba.